10月24日,以致敬AI开发者为主题的人工智能盛会——第二届世界声博会暨2019科大讯飞1024全球开发者节隆重开幕。大会设立了24场分论坛详解全域AI,聚集120多位AI前进者发表主题演讲,且拥有10000多平方米的生态伙伴AI产品展区。本届盛会受到海内外智能产业从业者和爱好者高度关注,超过1.4万开发者们齐聚一堂,为期三天的活动,预计吸引线上线下共105万AI爱好者共赴这场AI追光之旅。科大讯飞董事长刘庆峰、轮值总裁胡郁、京东物联总裁周炯等莅临大会并发表主题演讲。

作为科大讯飞智能汽车战略合作伙伴,自行科技受邀参会。公司联合创始人兼CEO关艳峰博士出席并发表“智能座舱多模态感知与融合”主题演讲,从智能座舱演进、多模态感知与融合、智能座舱应用及未来发展趋势等多个角度阐述了其对智能座舱的深度洞察,并分享了公司在智能座舱多模态感知融合、ADAS+DMS+HMI、人脸+语音解锁车门等方面的应用与落地。以下是关艳峰博士观点整理——

AI感知技术为智能座舱赋能

人工智能时代到来,为汽车产业不断创造了新的价值同时也带来了新的挑战,汽车智能化、网联化愈发明显。汽车座舱作为人车交互的接口,也将被赋予更大的意义。传统座舱软硬件非常分散,零部件多,但是互动性和同步协作性不强,导致座舱内信息非常碎片化,对于人机交互非常不友好,体验感不强,智能性不强,因此无论是OEM还是消费者都希望能用一种更加智能的新一代座舱来搭建人车之间的沟通桥梁。

汽车座舱发展可以分为四个阶段:传统座舱、信息座舱、智能座舱与无人驾驶座舱。传统座舱以指针仪表、按键开关为主,设计相对简单。信息座舱增加了液晶仪表、娱乐导航、T-Box等新的信息呈现设备,座舱内信息内容更丰富,智能化能力初步显现。智能座舱则在信息座舱的基础上增加了对驾驶员和乘客的语音、图像、手势及整车智能(ADAS/DMS)等方面的感知,通过多模态信息感知与融合,为消费者提供智能化辅助和服务。无人驾驶座舱则是座舱发展的终极目标,座舱可能会具备智能自我提升能力,能够对人/车/环境等进行深度融合,座舱结构布局也将会发生重大变化。

今天重点探讨未来几年内就有可能普遍落地的汽车座舱——智能座舱。智能座舱不仅需要座舱能够对车辆和道路环境进行实时感知,还需要能智能感知驾乘人员的状态信息,智能座舱中的智能化技术将是汽车座舱实现智能化最关键的技术之一。不同于以往座舱,智能座舱不仅要从车辆本体和网络上获取信息,更要从驾驶员、乘客以及车外环境中感知更多更复杂的信息,通过语音识别、图像识别、手势识别、行为识别等多种AI技术,为驾乘人员提供智能化、个性化的新型服务。

但是,当前大部分智能座舱产品存在一个问题:虽然智能座舱上配备了越来越多的传感器,但是几乎都是单模态感知、单独交互,独立工作,彼此间的关联性不强,大大降低了信息感知的价值。因此我们希望能够改善这些问题,也就是我今天要说的多模态感知与融合。

多模态感知融合让座舱更智能、更懂你

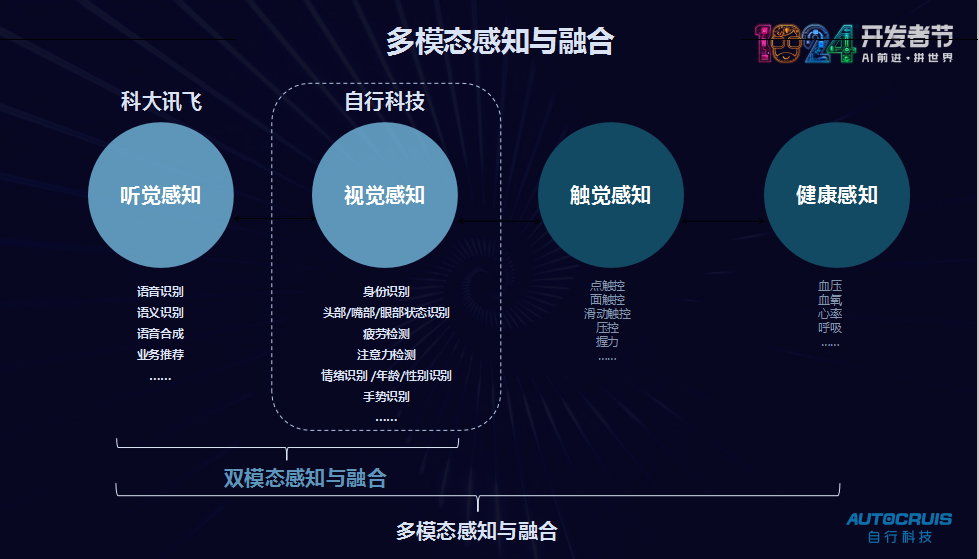

多模态感知(融合)是多种传感器信息的深度融合,目的就是实现1+1>2的效果,它可以实现更精准、更高可信度的感知,进而提供更好的信息和服务,包括类别、语义、行为、精度等等。在当前感知技术中,语音与图像识别是感知座舱驾乘人员与环境信息最有效的方式,因此,语音与图像的感知融合就非常重要和必要。

自行科技是一家以AI与嵌入式技术为核心的新型智能汽车电子服务商,是中国驾驶员监控国家标准制定成员企业和Bosch中国、丰田通商、Xilinx、华为(Hicar)的战略合作伙伴。公司以车内与车外短中长距离视觉感知与融合技术为核心,为前装乘用车与商用车厂提供前向ADAS、驾驶员监控、智能全景影像、盲区检测、智能座舱系统等车内外一些列的感知模组与系统,开发出国内首款基于深度学习技术的驾驶员监控系统,在图像识别、语音与图像感知融合、视觉与毫米波雷达融合等领域有多年的技术积累。

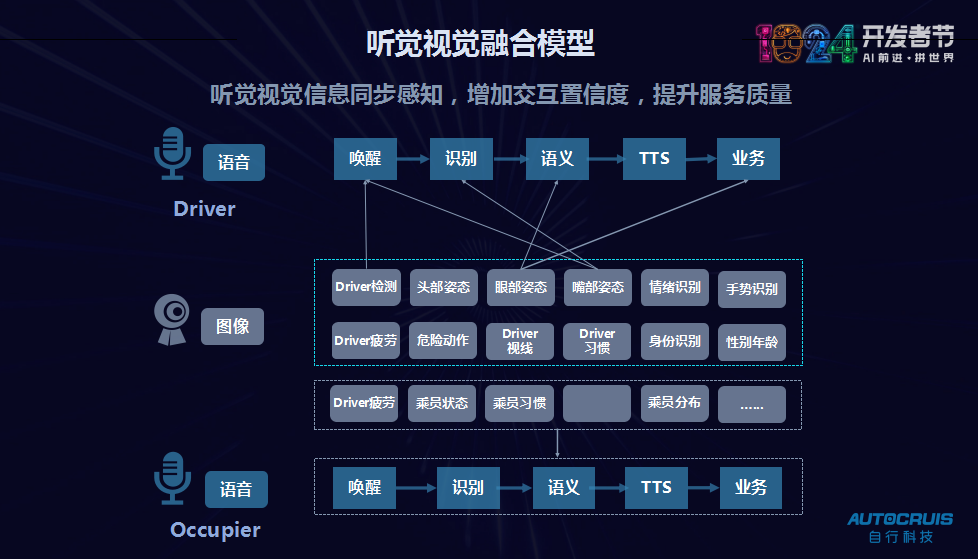

自行科技听觉视觉融合模型

自行科技融合方案通过视觉感知与语音融合技术,同步获取驾乘人员图像与语音信息,深度融合图像语音信息,更精准地获取驾乘人员地身份、意图、情绪、方位等信息,为其提供更好的智能化辅助与服务。通过深度学习技术,公司对驾乘人员进行面部特征点检测(眼睛状态/视线/嘴型/表情/年龄/性别等)、头部姿态三轴估计、行为检测,结合语音识别、语音识别、语音合成、TTS等语音识别技术,深度融合语音图像信息,基于融合判断策略决定后续业务和功能触发,增加交互可信度。

自行科技语音视觉融合方案

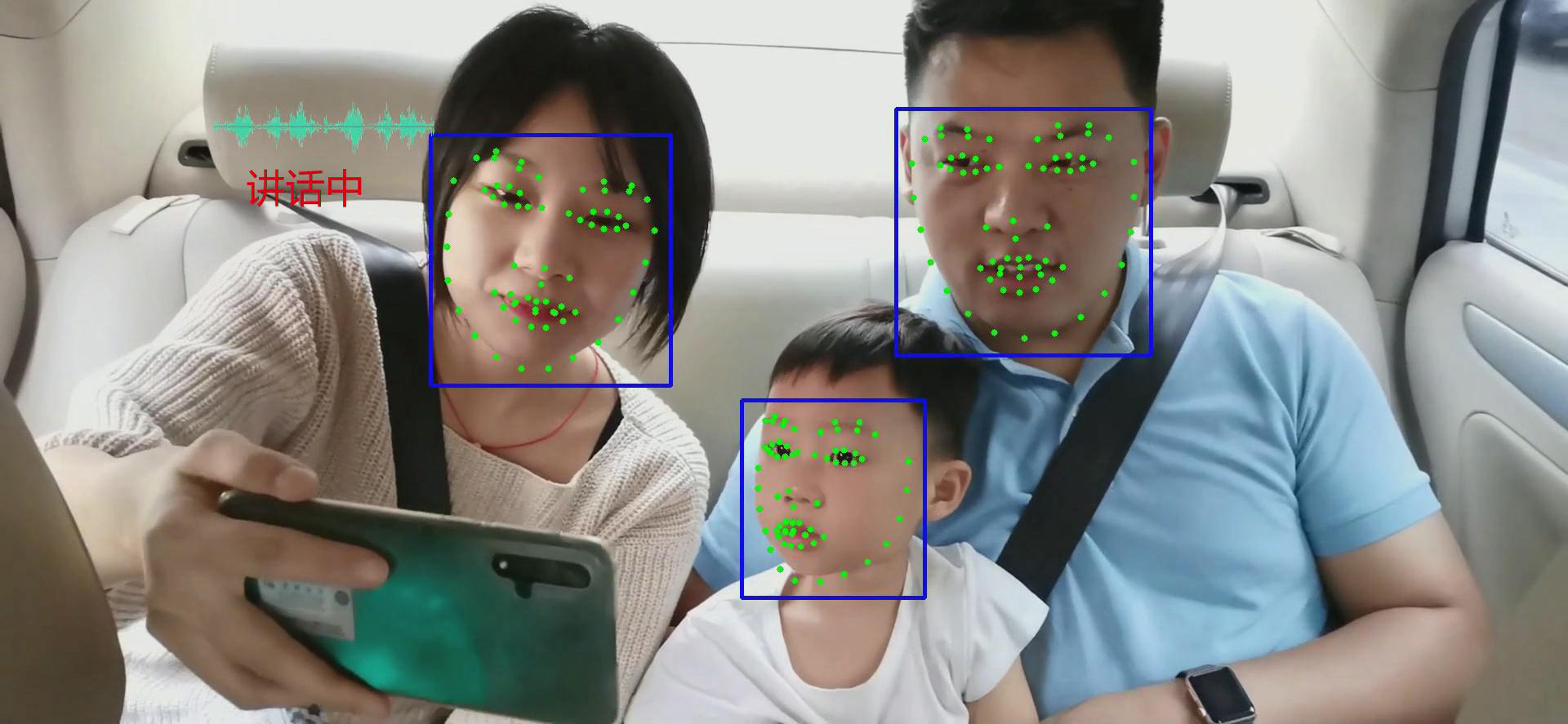

举个例子,公司通过车内感知技术,不仅可以精准感知驾驶员身份、疲劳、分心、危险动作、情绪、视线、、年龄、性别等信息,还可以对全车舱乘客与环境进行实时感知,包括对副座、后排乘客(儿童)进行人脸、年龄、性别、嘴型、落座情况、异常行为进行检测,通过图像识别与语音信息融合,快速判断目标是否讲话,是否需要进行语音唤醒等,提高在嘈杂环境下人机交互体验。

自行科技后排乘客检测方案

在语音图像信息融合的过程中,数据的同步和匹配非常关键。如果两类信息不能同步,那么容易产生错误的匹配,反而容易给用户造成困扰。第二个就是数据如何匹配,单模态数据都会产生判断,我们该如何判断哪类信息准确,哪类不准确,多模态融合应该如何进行逻辑判断,如何最终为用户提供更精准的判断结果。在这里,自行科技基于视觉感知数据进行了3.5级结构化数据分类,从功能大类、功能小类、特征指标及其它们的重要性都做了系统的区分,为客户提供系统的,完整的,可深度融合的感知数据结构。

当然,公司也在其他多模态融合技术上进行了深度开发,比如公司与国内知名乘用车OEM提供整套人脸解锁车门方案,通过对人脸识别、人脸防伪检测、语音识别和解锁触发,可在100ms内快速识别驾驶员身份后智能解锁车门,为用户提供高效精准的智能服务。同时,公司也基于前向ADAS系统、驾驶员监控系统、语音识别技术为客户提供个性化HMI(显示)开发,从视觉感知、语音识别、视觉呈现等多方面提供智能座舱多模态交互。

结语

随着人工智能、自动驾驶和5G等技术的快速发展,智能座舱将会集成ADAS、IoT、V2X等新兴技术,从硬件模块、感知信息、交互方式等多维度进行深度融合,成为整车实现信息化、安全化、舒适化、无人化的重要部件。智能座舱将会让整车系统更加智能,更懂你,具备更高的情商,实现人车合一,进而成为新一代的人车智能移动空间,真正成为人类的第二空间。